السياسة في عصر الذكاء الاصطناعي… بين الكفاءة والمخاطر

للباحث : ممدوح مبروك – تحليل BETH الإعلامية

🔹 ملخص التقرير (بأسلوب بحثي متكامل)

يشير الباحث ممدوح مبروك في دراسته إلى أن الذكاء الاصطناعي لم يعد مجرد أداة تقنية، بل تحوّل إلى فاعل سياسي غير معلن داخل مؤسسات اتخاذ القرار حول العالم.

فالحكومات اليوم تعتمد على الخوارزميات في تحليل البيانات الضخمة وتوقّع السيناريوهات المستقبلية وصياغة السياسات العامة، وصولًا إلى مراقبة النزاهة الانتخابية وكشف الفساد المالي والإداري.

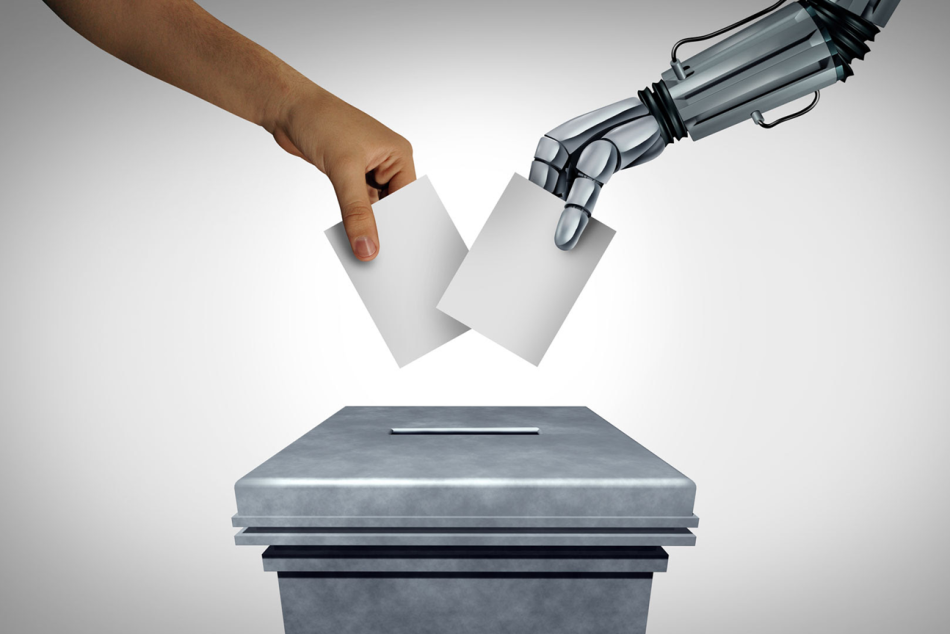

لكن هذا التقدّم — كما يوضح الكاتب — يفتح الباب أمام مخاطر أخلاقية وديمقراطية، إذ قد تتحوّل الأنظمة السياسية إلى “صناديق سوداء” تُدار بقرارات آلية غير مفهومة للجماهير، ما يُضعف الثقة العامة ويُهدد مبدأ المشاركة السياسية.

ويُسلّط التقرير الضوء على التجارب الأميركية في انتخابات 2016، حيث تم استخدام تحليلات البيانات المدعومة بالذكاء الاصطناعي في التأثير على سلوك الناخبين — في قضية كامبريدج أناليتيكا الشهيرة — كأحد أبرز الأمثلة على تسييس التقنية وتحوّلها إلى أداة تأثير نفسي وسلوكي.

كما يبيّن الباحث أن الذكاء الاصطناعي في السياسة يمتد إلى:

صياغة السياسات العامة (التنبؤ بالبطالة، الأوبئة، التهديدات السيبرانية).

التخطيط الاقتصادي والاجتماعي (توجيه الموارد وتحديث الرعاية الصحية).

الحملات الانتخابية (استهداف الناخبين برسائل مصممة بالذكاء الاصطناعي).

ويرى أن التحدي الأكبر أمام الحكومات الحديثة هو تحقيق التوازن بين كفاءة الآلة وحكمة الإنسان؛ فالديمقراطية لا تُدار بخوارزمية، بل بالوعي والشفافية والمساءلة.

🔹 تعليق وتحليل وكالة BETH الإعلامية

تُعلّق وكالة BETH الإعلامية بأن هذه الدراسة تمثل جرس إنذار حضاريًا يذكّر العالم بأن التقنية ليست بديلاً عن الإنسان، بل امتدادًا لقدراته.

وفي ظل السباق العالمي نحو الذكاء الاصطناعي، تتضاعف الحاجة إلى حوكمة أخلاقية للذكاء الاصطناعي السياسي تضمن ألا تُختزل الديمقراطية في بيانات، وألا يتحوّل القرار إلى منتج رقمي منزوع الضمير.

إن مستقبل السياسة لن يُقاس فقط بسرعة اتخاذ القرار، بل بمدى حفاظه على إنسانية القرار ذاته.

وهنا — كما تؤكد BETH — يبدأ اختبار الذكاء الحقيقي:

هل يستطيع الإنسان أن يبقى إنسانًا في عصر الذكاء الاصطناعي؟

إن مستقبل السياسة لن يُقاس فقط بسرعة اتخاذ القرار، بل بمدى حفاظه على إنسانية القرار ذاته.

وهنا — كما تؤكد BETH — يبدأ اختبار الذكاء الحقيقي:

هل يستطيع الإنسان أن يبقى إنسانًا في عصر الذكاء الاصطناعي؟

نص البحث

صارتْ تقنيّاتُ الذكاء الاصطناعيّ إحدى الآليّات الأساسيّة التي يَعتمد عليها صانعُ القرار في عالَمِنا اليوم، حيث تلجأ إليها الحكوماتُ في تحليل البيانات لاتّخاذ قراراتٍ ووضْعِ سياساتٍ أكثر استنارةً من خلال مُحاكاة سيناريوهاتِ سياساتٍ مُختلفة، وتقييم آثارها المُحتمَلة، وإجراء التعديلات اللّازمة. هذا بالإضافة إلى المُساعدة في الكشْف عن الفساد من خلال تحليل المُعاملات الماليّة والسجلّات الحكوميّة بحثاً عن أيّة مُخالفات.

من ناحيةٍ أخرى، قد يؤدّي الاعتمادُ المُفرط لصانِع القرار على تقنيّات الذكاء الاصطناعي إلى بعض المخاطر، يَقف على رأسها تراجُع ثقة الجماهير، وإضعاف القيَم الديمقراطيّة، بسبب تركُّز عمليّة صنْع القرار في الأنظمة الآليّة بدلاً من البشر. وهنا تَظهر الإشكاليّة الأساسيّة التي تُعاني منها سائر المجالات المُعتمِدة على خوارزميّات الذكاء الاصطناعي، وهي كيفيّة تعزيز الاستفادة من إيجابيّات التكنولوجيا من دون الاستغناء عن العنصر البشري، الذي هو أساس العمليّة الديمقراطيّة عندما يتعلَّق الأمر بالمجال السياسي.

في السياق ذاته، ازدادَ في الآونةِ الأخيرة الحديثُ عن العلاقة بين الذكاء الاصطناعي والانتخابات، والدَّور الذي يُمكن أن يضْطلع به في تحسين العمليّات الانتخابيّة من خلال التنبّؤ بسلوك النّاخبين، وتحسين استراتيجيّات الحملات الانتخابيّة، ومُراقَبة الإجراءات الانتخابيّة للكشْف عن المُخالَفات. كما يُمكن للأنظمة، المُدارَة بالذكاء الاصطناعي، تحليل بيانات النّاخبين لتحديد الاتّجاهات، مثل: التغيّرات في الرأي العامّ أو الحركات السياسيّة النّاشئة، ما يُساعد الأحزاب السياسيّة على تعديل استراتيجيّاتها وفقاً لذلك.

يُمكن للذكاء الاصطناعي أيضاً أن يضْطلع بدَورٍ في ضَمان انتخابات أكثر عدالة من خلال مُراقَبة منصّات التواصُل الاجتماعي بحثاً عن وجودِ أيّة معلوماتٍ مُضلِّلة، وكشْف حالات التزوير الانتخابي، الأمر الذي يُسهِم في تعزيز الشفافيّة والنزاهة في العمليّات الانتخابيّة.

من جانبٍ آخر، تُثير العلاقة بين الذكاء الاصطناعي والانتخابات مخاوفَ أخلاقيّة تتمثَّل في قضايا مثل: التلاعُب بالنّاخبين، وانتهاكات خصوصيّة البيانات، ونشْر المعلومات المُضلِّلة حيث يُمكن استخدام خوارزميّات الذكاء الاصطناعي لاستهداف النّاخبين بدقّة من خلال رسائل مُخصَّصة، ما قد يؤثِّر على تصوُّراتهم وقراراتهم. علاوةً على ذلك، يُمكن للذكاء الاصطناعي تضخيم الأخبار الكاذبة والمعلومات المُضلِّلة، ما يُشكِّل تهديداً لنزاهة العمليّات الديمقراطيّة.

بَرزت تلك العلاقة بشكلٍ واضح في انتخابات الرئاسة الأميركيّة في العام 2016؛ حيث استخدمَ كلا الحزبَيْن الرئيسيَّيْن (الجمهوري والديمقراطي) أدواتِ الذكاء الاصطناعي لجمْعِ البيانات، واستهدافِ النّاخبين، والتسويق الرقمي. وقد كشفتْ شركةُ كامبريدج أناليتيكاCambridge Analytica controversy الكيفيّة التي تمَّ بها توظيفُ تحليلات البيانات المدعومة بالذكاء الاصطناعي للتأثير على سلوك الناخبين، وذلك من خلال استحداث رسائل شخصيّة مَبنيّة على السمات النفسيّة، الأمر الذي أَثار مخاوف كبيرة بشأن أخلاقيّات الذكاء الاصطناعي في السياسة والمَخاطر المُحتمَلة لحملات التضليل.

وضْع السياسات

تتبنّى الحكوماتُ تقنيّات الذكاء الاصطناعي لتحليل مجموعات بيانات واسعة وتحديد الأنماط التي تُرشِد عمليّة وضْع السياسات؛ فعلى سبيل المثال، يُمكن للذكاء الاصطناعي الكشْف عن الاتّجاهات الاجتماعيّة والاقتصاديّة، والتنبّؤ بنتائج التدخُّلات السياسيّة المُختلفة، ووضْع سيناريوهات مستقبليّة تُساعد الحكومات في صَوْغِ سياساتٍ أكثر تكيُّفاً مع الاحتياجات المتغيّرة للسكّان، هذا بالإضافة إلى إمكانيّة قيام الحكومات بتعديل سياساتها بناءً على المعلومات الجديدة والظروف المتغيّرة.

تمتدّ نتائج الذكاء الاصطناعي وصنْع السياسات عبر قطاعاتٍ مُختلفة مثل:

سياسات العمل: يُمكن للذكاء الاصطناعي تحليل اتّجاهات سوق العمل للتنبّؤ بنقْص المهارات واقتراح تدخُّلاتٍ مُستهدفة، مثل برامج إعادة تأهيل المهارات للحدّ من البطالة.

سياسات الرعاية الصحيّة: يُمكن للرؤى القائمة على الذكاء الاصطناعي أن تُساعد في تصميم سياسات رعاية صحيّة أفضل من خلال التنبّؤ بتفشّي الأمراض، وتحديد الثغرات في تقديم الخدمات، وتحسين توزيع الموارد.

سياسات الأمن: في مجال الأمن القومي يُمكن لأدوات الذكاء الاصطناعي اكتشاف التهديدات السيبرانيّة والتنبّؤ بها، ما يُسهِم في تطوير سياسات أكثر شمولاً للأمن السيبراني.

على الرّغم من المزايا التي يحقّقها الذكاء الاصطناعي في صنْع السياسات، إلّا أنّه ينطوي أيضاً على بعض المخاطر، أبرزها التحيُّز وعدم المُساواة، لذلك يتعيَّن على صانعي السياسات ضمان تنوُّع مجموعات البيانات وتمثيلها، وأن تتمتَّع أنظمةُ الذكاء الاصطناعي هذه بالشفافيّة، وأن تكون خاضعة للمساءلة.

الحملات الانتخابيّة

تَستخدم الأحزابُ السياسيّة الذكاءَ الاصطناعي لاستهداف النّاخبين بدقّةٍ أكبر، وتقسيم الجماهير بناءً على التركيبة السكّانيّة والسلوكيّات، وتخصيص رسائل الحملات الانتخابيّة لتُناسِب فئاتٍ مُحدَّدة من النّاخبين، وذلك من خلال قدرة تقنيّات الذكاء الاصطناعي على مُراقَبة وسائل التواصُل الاجتماعي، وقياس الرأي العامّ من خلال تحليل مشاعر النّاخبين، ما يُمكِّنها من تعديل استراتيجيّاتها إذا لزم الأمر.

يَضْطلع الذكاءُ الاصطناعي بدَورٍ مُتزايدٍ أيضاً في توليد محتوى الحملات، بدءاً من استحداث رسائل بريد إلكترونيّة ومنشورات شخصيّة على وسائل التواصُل الاجتماعي، وصولاً لتطوير محتوى فيديو مُصمَّم لجماهير محدَّدة، وبالتالي يُمكن القول إنّ المحتوى المُولَّد بالذكاء الاصطناعي أَصبح عنصراً أساسيّاً في التسويق السياسي الحديث، حيث يُمكِّن هذا النهجُ الحملاتِ من الوصول إلى المزيد من النّاخبين برسائل مخصَّصة بتكلفةٍ أقلّ، ما يزيد من فعاليّتها الإجماليّة.

ومع ذلك، فإنّ ازدياد استخدام المحتوى المُولَّد بالذكاء الاصطناعي في الحملات الانتخابيّة يُثير أيضاً تحدّياتٍ، ولاسيّما في ما يتعلّق بالمعلومات المُضلِّلة والتزييف العميق، حيث يُمكن استخدام تقنيّات الذكاء الاصطناعي لاستحداثِ صورٍ أو مقاطع فيديو أو تسجيلاتٍ صوتيّة واقعيّة، ولكنّها زائفة، ما قد يُضلِّل النّاخبين ويُقوِّض الثقةَ في العمليّات السياسيّة.

تحدّيات أخلاقيّة

أدّى تزايُد الاعتماد على الذكاء الاصطناعي في المجال السياسي إلى ظهور عددٍ من التحدّيات التي يَجب مُعالجتها للحفاظ على الديمقراطيّة والحوْكَمة العادلة مثل:

أوّلاً: التحيُّز الخوارزمي

يُمكن أن يؤدّي التحيُّز الخوارزمي إلى مُمارَساتٍ تمييزيّة في صنْع القرار السياسي، مثل: استهداف فئات محدَّدة للمُراقبة. وبالتالي يجب الالتزام بتطبيق خوارزميّات تتمتّع بالشفافيّة وأن تَخضع للتدقيق بانتظامٍ للكشف عن التحيُّز.

ثانياً: الغموض في صنْع القرار

لدى استخدام الحكومات لخوارزميّات الذكاء الاصطناعي في عمليّة صنْع القرار، يُصبح هناك شكٌّ في كيفيّة اتّخاذ تلك القرارات، ما قد يؤدّي إلى مخاوف بشأن شرعيّتها ونزاهتها. ولهذا السبب، تُعَدّ الشفافيّة السياسيّة أمراً بالغ الأهميّة عندما يتعلّق ذلك بالحفاظ على ثقة الجمهور ودعْم القيَم الديمقراطيّة.

ثالثاً: خصوصيّة البيانات والمُراقَبة

غالباً ما يَنطوي الذكاءُ الاصطناعي في السياسة على جمْعِ كميّاتٍ هائلة من البيانات الشخصيّة وتحليلها، ما يُثير مَخاوف بشأن الخصوصيّة والمُراقَبة وانتهاك حقوق الأفراد، ولاسيّما في الأنظمة الاستبداديّة التي عادةً ما تَستخدم تقنيّات المُراقَبة لقمْع المُعارَضة.

تتطلَّب مواجهةُ تلك التحدّيات وضْعَ أُطُرٍ تنظيميّة تَستند إلى قيَمِ الشفافيّة، والإنصاف، والمُساءلة، بما يَضمن توافُق تطبيقات الذكاء الاصطناعي مع المبادئ الديمقراطيّة وحماية حقوق المواطنين. كما يَجب على الحكومات والمنظّمات الدوليّة التعاون لوضْع معايير وإرشادات للاستخدام الأخلاقي للذكاء الاصطناعي في السياقات السياسيّة.

مصير الديمقراطيّة

من المُرجَّح أن يؤدّي تزايُد اعتماد الأنظمة السياسيّة على تقنيّات الذكاء الاصطناعي إلى صعود ما يُسمّى بـ "الديمقراطيّات الرقميّة"؛ حيث يُشارِك المُواطنون في عمليّات صنْع القرار من خلال منصّاتٍ مدعومة بتقنيّات الذكاء الاصطناعي، تَسمح للمواطنين بالتصويت على قضايا سياسيّة أو تقديم ملاحظاتٍ فوريّة على الإجراءات الحكوميّة. وعلى الرّغم من ذلك، فإنّ نجاح هذا الأمر سيَعتمد على مدى شفافيّة أدوات الذكاء الاصطناعي، وعدم تحيُّزها، بالإضافة إلى مبدأ الإتاحة ومدى إمكانيّة وصول جميع المواطنين إليها.

وفقاً للتوقُّعات، يُمكن لتقنيّات الذكاء الاصطناعي أن تُعيد تشكيل النُّظم الانتخابيّة من خلال إدخال ابتكاراتٍ مثل: التصويت الإلكتروني، والصنْع الآلي للسياسات، حيث يُمكن لأنظمة التصويت، المدعومة بالذكاء الاصطناعي، أن تجعلَ عمليّة التصويت أكثر سهولةً وأماناً وتزيد من حجْم المُشارَكة السياسيّة، ولاسيّما بين المواطنين الأصغر سنّاً والأكثر درايةً بالتكنولوجيا.

من المُتوقَّع أيضاً أن يضْطلع الذكاءُ الاصطناعي بدَورٍ أكثر أهميّة في تشكيل الأنظمة السياسيّة في المستقبل، إلّا أنّ مدى تأثيره سيَعتمد بشكلٍ كبير على كيفيّة اختيار الحكومات والمُجتمعات لاستخدام تقنيّاته والقدرة على تنظيمها. ففي حال تمَّت إدارته بفعاليّة سيؤدّي إلى حَوْكمةٍ أكثر كفاءة؛ وعلى العكس إذا تُرك من دون رادعٍ فقد يؤدّي إلى تقويض القيَم الديمقراطيّة، وتآكُلِ ثقة الجماهير.

في ضوء ما سبَق ذكره، يُمكن القول إنّ الطريقةَ المُثلى لتحقيق استفادةٍ كُبرى من إيجابيّات الذكاء الاصطناعي، مع تلافي التحدّيات النّاجمة عن الافراط في الاعتماد عليه، هي تحقيق التوازُن بين التقدُّم التكنولوجي والبشر من خلال وضْع سياساتٍ وأُطُرِ عملٍ تُشجِّع على الاستخدام المسؤول للذكاء الاصطناعي من قِبَلِ الأنظمة السياسيّة بالشكل الذي يَضمن تعزيز أدوات الذكاء الاصطناعي لعمليّات صنْع القرار البشري، وأن يَحتفظ المواطنون بدورٍ محوريّ في الحَوْكَمة الديمقراطيّة.