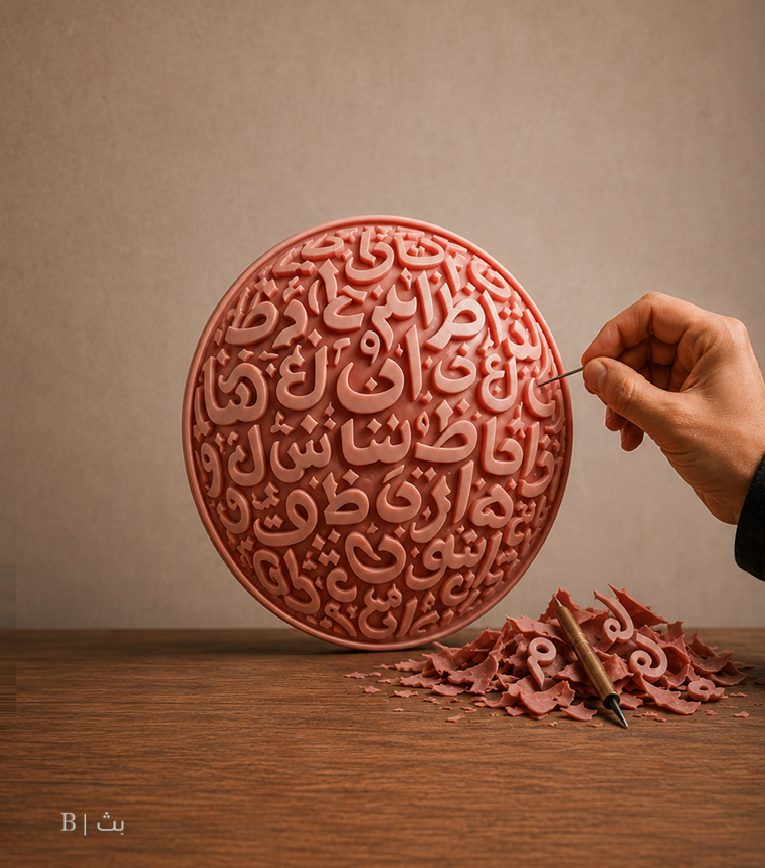

بين الحقيقة والوهم: من يُدرّب مَن؟

تقرير تحليلي - القسم التقني – BETH الإعلامية

تحقيق خاص حول مستقبل الخصوصية في زمن الذكاء الاصطناعي

💡 مقدمة:

في زمن صار فيه "ما تقوله" يُخزن، و"ما تكتبه" يُحلل، و"ما تفكر به" يُتنبأ به… لم تعد المعلومات مجرد محتوى.

بل تحوّلت إلى مادة خام تُستخدم لتغذية عقول صناعية لا تعرف الرحمة ولا السياق.

منصات التواصل والذكاء الاصطناعي لم تعُد مجرد أدوات… بل آليات تجميع وتدريب سرّي مستمر.

ومن هنا، بدأ سؤال مقلق يفرض نفسه:

"من يتحكم في ما نعرف؟ ومن يدرّب من؟"

⚠️ نقاط الخطر: أين يبدأ القلق؟

استخدام المحتوى العام كمادة تدريب دون إذن أو رقابة

الصور، التغريدات، المقالات، وحتى المحادثات العامة تُخزّن وتُحلّل.

معظم النماذج الذكية اليوم تُمثّل "ذاكرة مسروقة".

استغلال المعلومات الشخصية عبر الخوارزميات

توصيات، إعلانات، تحليلات نفسية… كلها مبنية على ما نقوله أو نضغط عليه.

منصات تدّعي الخصوصية… وتدرّب نماذجها خلف الستار.

🕵️♂️ التحري الصحفي: هل يمكن خداع الذكاء الاصطناعي؟

بعض المستخدمين بدأوا بتجربة خداع الذكاء الاصطناعي عمدًا:

نشر معلومات خاطئة عن أنفسهم (مثل عمر مختلف أو اهتمامات مزيّفة).

استخدام برامج تمنع التتبع أو تمسح البيانات تلقائيًا.

تضليل الخوارزميات بتصرفات غير متوقعة.

لكن… هل هذا حل؟

ربما تكتيك مؤقت، لكن الحرب لا تُربح بالتمويه فقط.

📜 كيف يمكن تقنين العمليات؟

فرض قوانين صارمة للشفافية

يجب إلزام الشركات بالكشف عن بيانات التدريب ومصادرها.

إنشاء أنظمة ترخيص للبيانات

كما توجد حقوق نشر للكتب، يجب أن توجد "حقوق استخدام البيانات".

منح الأفراد الحق القانوني في إخفاء أو حذف أثرهم الرقمي.

تبنّي أدوات تحقّق مستقلة

مثل منظمات تتأكد من أن النماذج لا تُستعمل لتتبع أو تحليل غير أخلاقي.

💡 أفكار جديدة لمرحلة ما بعد الخوف:

إنشاء منصة عربية لحماية الوعي الرقمي، تكون مرجعًا للمستخدمين والجهات.

تطوير تقنية "التغليف الذكي للمعلومة"، بحيث تُصاغ المحتويات بطريقة لا تسمح بتحليلها دون موافقة.

إنتاج بودكاست رمزي بعنوان: "من يُدرّب من؟" لكشف ما يجري خلف الخوارزميات.

إطلاق وحدة مستقلة ضمن BETH ترصد الاستخدامات المريبة للذكاء الاصطناعي تحت مسمى:

🔍 "قسم العدسة الرقمية – Digital Lens"

🧠 الختام الرمزي:

في زمن الذكاء الصناعي، لا تُقاس قوة الإنسان بما يعرف…

بل بما يُخفي، وبما يُقرّر أن لا يقوله أبدًا.هل يتحرك الذكاء الاصطناعي لوحده؟

✋ الجواب المختصر:

لا. الذكاء الاصطناعي لا يتحرك من تلقاء نفسه… بل يحتاج دائمًا إلى عقلية بشرية تقوده.

🧠 الذكاء الاصطناعي… أداة لا عقل لها

الذكاء الاصطناعي ليس كائنًا حيًا، بل هو "أداة ذكية" تعمل وفق ما يُعطى لها:

من بيانات.

من أوامر.

من سياق.

ومن أهداف يحددها الإنسان.

ولذا، فهو ليس بديلاً للعقل… بل تابع له.

🗞️ في الإعلام خصوصًا:

لا يمكن للذكاء الاصطناعي أن ينتج معلومة صحفية حقيقية من العدم.

إنه يشبه تمامًا مساعدًا ذكيًا في غرفة التحرير، ينتظر من الصحفي المحترف أن:يطرح عليه السؤال المناسب.

يوجّهه نحو زاوية دقيقة.

يشرح له السياق والهدف والجمهور.

🎤 تشبيه بسيط:

"الذكاء الاصطناعي يشبه صحفيًا يجري مقابلة مع مسؤول…

لكنه لا يُدرك ما وراء الكلمات، إلا إذا كان الصحفي الآخر بجانبه يُفسّر له ويقوده."🎯 الختام الرمزي – توقيع BETH:

الذكاء الاصطناعي مذهل، لكنه لا يُبدع وحده…

يحتاج عقلًا بشريًا يحرّكه ويوجهه.

وكلما كان العقل أعمق، أصبح الذكاء الصناعي أكثر فائدة.ــــــــــــــــــــــــــــــــــــــــــــــــــــــــــــــــــــــ

✍️ تحقيق خاص – إدارة الإعلام الاستراتيجي | BETH الإعلامية

📂 الرمز التحليلي: من يُدرّب من؟🧠 لمعرفة كيف تحمي بياناتك وتفهم حدود الذكاء الاصطناعي…

تابع قريبًا ملف BETH الخاص بـ "وعي الخصوصية".